Indexation Google : tout comprendre pour faire indexer son site en 2026

Temps de lecture : 14 minutes

🔑 L’essentiel à retenir

- L’indexation Google est l’étape qui rend une page éligible aux résultats de recherche — sans elle, aucun ranking possible.

- Le processus se déroule en trois phases : crawl, rendu, indexation — chaque page doit passer ces trois filtres.

- Depuis 2024-2025, Google applique une indexation sélective : 30 à 60 % des pages d’un site moyen peuvent rester hors index.

- Les deux statuts critiques en Search Console : « Détectée, non indexée » (budget crawl) et « Explorée, non indexée » (qualité).

- Une pénalité Google peut désindexer brutalement un site — comprendre les signaux de qualité protège l’index.

✅ Diagnostic indexation : les 8 points à vérifier sur votre site

0 / 8 étapes complétées

Sommaire

- Indexation Google : définition et rôle dans le référencement

- Comment fonctionne l’indexation : crawl, rendu, index

- Diagnostic : votre site est-il bien indexé ?

- Les statuts d’indexation dans Google Search Console

- Optimiser son site pour l’indexation

- Pénalité Google : quand l’index se referme

- Alternatives et approches complémentaires

- Erreurs fréquentes qui plombent l’indexation

- FAQ : questions fréquentes sur l’indexation Google

Indexation Google : définition et rôle dans le référencement

L’indexation Google désigne le processus par lequel le moteur de recherche découvre une page web, l’analyse, puis décide de la stocker dans son immense base de données — l’index. Sans cette étape, une page n’existe tout simplement pas pour Google : aucun positionnement, aucun trafic organique, aucune visibilité. C’est l’étape silencieuse mais fondatrice de tout le référencement naturel.

Beaucoup de webmasters confondent indexation et ranking. L’indexation rend la page éligible aux résultats. Le ranking détermine son rang. Une page peut être indexée sans jamais ressortir en première page, mais une page non indexée ne ressortira jamais, même si elle est parfaite. Cette nuance change tout dans le diagnostic d’un projet SEO.

Sur les projets qu’on suit, on constate systématiquement un écart entre le nombre de pages soumises et le nombre de pages réellement indexées : pour un site éditorial moyen, 30 à 60 % des URLs peuvent rester hors index. Plus le site grandit, plus Google devient sélectif. Comprendre ce filtre est devenu une compétence SEO incontournable.

Pourquoi Google n’indexe pas tout

L’index Google contient des centaines de milliards de pages. Pour préserver la qualité des résultats et économiser ses ressources, Google applique une stratégie d’indexation sélective. Le moteur évalue la qualité, l’originalité, la pertinence et la cohérence de chaque page avant de la stocker.

Depuis les mises à jour Helpful Content et Core Updates successives, ce filtre s’est durci. Les contenus jugés faibles, dupliqués, générés sans valeur ajoutée ou orphelins (sans aucun lien interne) sont écartés. La documentation officielle de Google Search Central précise d’ailleurs que « Google n’est pas tenu d’indexer toutes les pages qu’il découvre » — c’est désormais un principe assumé.

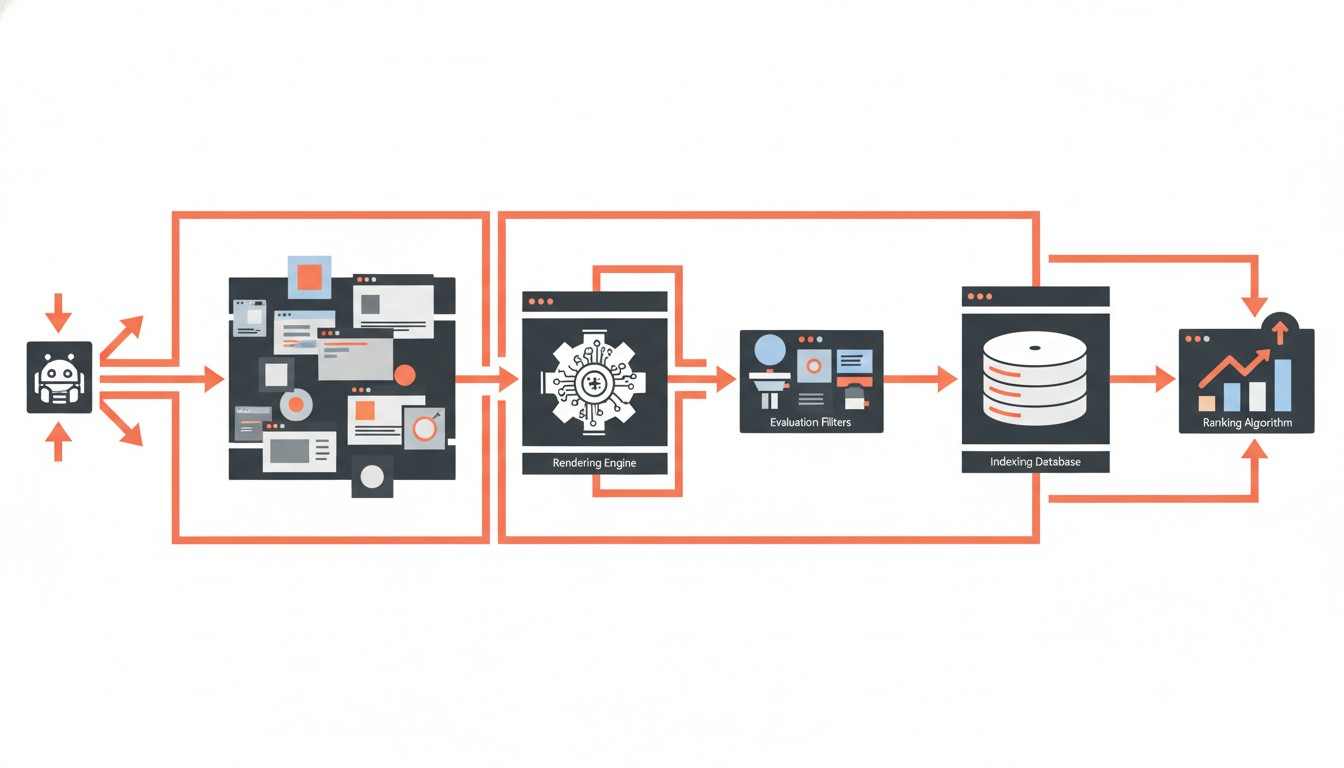

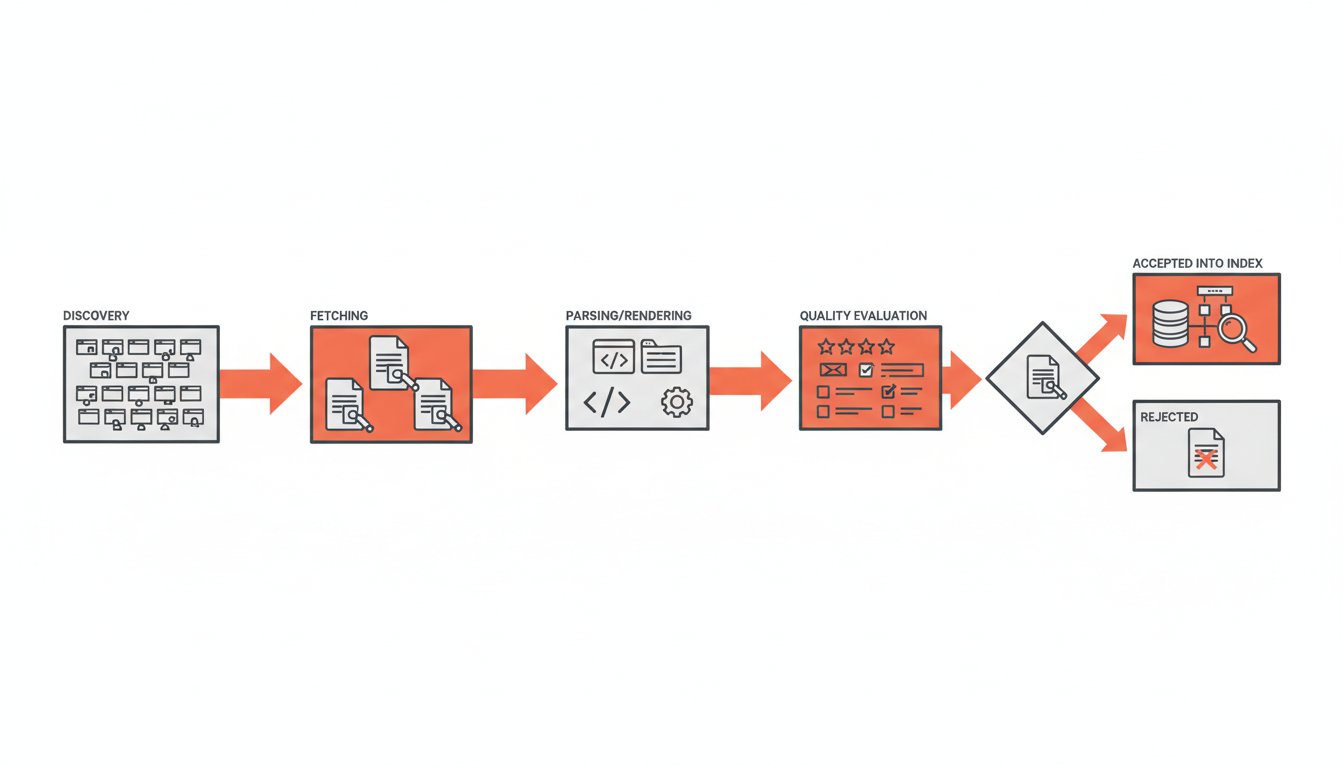

Comment fonctionne l’indexation Google : crawl, rendu, index

Le parcours d’une page de sa création à son apparition dans les résultats Google suit trois étapes techniques distinctes. Chacune est un point de friction où la page peut être retenue, retardée ou rejetée. Pour aller plus loin sur ce sujet, vous pouvez consulter notre article dédié au fonctionnement de l’indexation Google.

Étape 1 : la découverte et le crawl par Googlebot

Googlebot, le robot d’exploration de Google, parcourt le web en suivant les liens hypertextes. Il découvre une nouvelle page de deux manières : via un lien depuis une page déjà connue, ou via un sitemap soumis dans la Search Console. Sans lien entrant ni sitemap, une page reste invisible.

Le robot ne crawle pas tout, tout le temps. Chaque site dispose d’un budget de crawl alloué par Google, basé sur la santé technique du site, son autorité et la fréquence de mise à jour. Optimiser ce budget est devenu un sujet à part entière du SEO technique — sujet que nous détaillons dans notre guide pour optimiser son crawl budget.

Étape 2 : le rendu de la page

Une fois la page récupérée, Googlebot effectue un rendu. Il interprète le HTML, exécute le CSS et le JavaScript, puis reconstitue la page comme un navigateur le ferait. Cette étape est critique pour les sites construits en JavaScript moderne (React, Vue, Angular). Si le rendu échoue ou produit une page vide, l’indexation échoue avec lui.

Une erreur que l’on observe très souvent dans les audits : des sites SPA qui renvoient une coquille HTML vide côté serveur et reposent à 100 % sur le JS pour afficher le contenu. Googlebot finit par rendre la page, mais avec un délai pouvant atteindre plusieurs jours, ce qui pénalise lourdement l’indexation initiale.

Étape 3 : l’évaluation qualité et l’indexation

Après le rendu, Google évalue plusieurs signaux : qualité éditoriale, originalité, pertinence par rapport à la requête cible, signaux E-E-A-T, profondeur dans l’arborescence, présence de liens internes et externes pointant vers la page. Si l’ensemble dépasse un seuil interne (non communiqué), la page est ajoutée à l’index.

À noter que cette évaluation n’est pas binaire et définitive. Google peut désindexer une page qu’il jugeait correcte il y a six mois, simplement parce que les standards qualité ont évolué ou parce que la page a perdu de la fraîcheur. L’indexation est un état, pas un acquis.

Diagnostic : votre site est-il bien indexé ?

Avant de chercher à optimiser, il faut mesurer. Trois méthodes simples permettent d’évaluer l’état d’indexation d’un site, du diagnostic rapide à l’analyse fine.

Méthode 1 : la commande site: dans Google

Tapez site:votredomaine.fr directement dans Google. Le moteur renvoie une estimation du nombre de pages indexées de votre domaine. Cette méthode est approximative — Google n’affiche jamais le chiffre exact — mais donne une première mesure. Si vous avez publié 200 articles et que Google n’en renvoie que 40, l’alerte est claire.

Méthode 2 : le rapport d’indexation Search Console

C’est la source de vérité. Connectez votre propriété à Google Search Console et consultez le rapport « Indexation des pages ». Vous obtenez le nombre exact de pages indexées, les pages non indexées et la raison précise pour chacune.

Méthode 3 : le crawl externe et la comparaison

Outils comme Screaming Frog ou OnCrawl crawlent l’intégralité de votre site et vous indiquent combien de pages auto-référencées existent. La différence avec ce que Search Console indexe révèle votre taux d’indexation réel. Un taux sain se situe au-dessus de 80 % pour un site éditorial bien tenu.

Cas 1 — Vous lancez un nouveau site : la patience prime

Un site fraîchement mis en ligne met 2 à 8 semaines à atteindre un taux d’indexation stable. La priorité est d’envoyer des signaux clairs : sitemap, soumission via Search Console, premiers backlinks externes, structure plate (3 clics max depuis l’accueil). Inutile de paniquer avant 30 jours.

Cas 2 — Site établi avec chute d’indexation : urgence diagnostic

Si un site bien indexé voit son taux chuter brutalement, l’enjeu est différent. Les causes typiques : modification du robots.txt, déploiement d’une mauvaise canonique massive, migration mal préparée, ou pénalité algorithmique. Un audit SEO technique permet d’isoler la cause sous 48 heures.

Cas 3 — Site en croissance avec pages qui s’accumulent hors index : problème de qualité

Si vous publiez régulièrement et que les nouvelles pages restent « Détectée, non indexée », le signal est clair : Google ne juge pas votre contenu suffisamment utile pour mobiliser son crawl budget. C’est rarement un bug, c’est presque toujours un problème de fond éditorial ou structurel.

Les statuts d’indexation dans Google Search Console

La Search Console catégorise chaque URL connue dans un statut précis. Comprendre la signification de chaque libellé est essentiel pour agir efficacement. Voici les statuts les plus fréquents et leur interprétation.

« Indexée »

La page est dans l’index. Elle peut apparaître dans les résultats. C’est l’objectif pour toute page stratégique.

« Détectée, actuellement non indexée »

Google connaît l’URL mais ne l’a pas encore explorée. La cause est presque toujours un problème de budget crawl : Google ne juge pas prioritaire d’aller voir cette page. C’est typique d’un site jeune, mal maillé, sans autorité, ou d’un site très volumineux où Googlebot doit faire des choix.

« Explorée, actuellement non indexée »

Le statut le plus frustrant. Google a bien crawlé la page, mais a décidé de ne pas l’indexer. Cause principale : la qualité jugée insuffisante. Le contenu est perçu comme trop léger, trop proche d’autres pages, ou sans valeur ajoutée. Aucune correction technique ne suffira — il faut renforcer le fond.

« En double, l’URL canonique n’est pas celle sélectionnée par l’utilisateur »

Google a choisi une URL différente de celle indiquée par votre balise canonique. C’est un signal qu’il considère une autre page comme la version de référence. Souvent lié à du contenu dupliqué interne ou à une mauvaise configuration des canoniques.

« Exclue par la balise noindex »

Vous avez explicitement demandé à Google de ne pas indexer la page via <meta name="robots" content="noindex">. Si la page apparaît ici par erreur, supprimez la balise.

« Soft 404 »

La page renvoie un code 200 mais Google l’interprète comme une page d’erreur (contenu vide, message d’erreur visible, redirection vers l’accueil). À corriger en renvoyant un vrai 404 ou en remplissant le contenu.

| Statut Search Console | Cause principale | Action prioritaire |

|---|---|---|

| Détectée, non indexée | Budget crawl insuffisant | Renforcer maillage + backlinks |

| Explorée, non indexée | Qualité jugée insuffisante | Réécrire ou fusionner la page |

| Doublon canonique différent | Contenu dupliqué interne | Différencier ou désindexer |

| Soft 404 | Contenu absent ou vide | Renvoyer un vrai 404 ou enrichir |

| Exclue par noindex | Balise meta robots | Retirer la balise si erreur |

Optimiser son site pour l’indexation Google

Une fois le diagnostic posé, plusieurs leviers permettent d’améliorer significativement le taux d’indexation. Ces leviers se rangent en trois familles : technique, contenu, et popularité.

Levier 1 : la santé technique du site

Un site rapide, sans erreurs serveur, avec un sitemap propre et un robots.txt cohérent envoie un signal de confiance à Googlebot. Vérifiez en priorité :

- Le temps de réponse serveur (TTFB) inférieur à 600 ms ;

- Les Core Web Vitals dans le vert sur 75 % des pages ;

- L’absence de chaînes de redirections (un seul saut maximum) ;

- L’unicité des balises canoniques (chaque URL pointe vers elle-même sauf cas explicite) ;

- Un sitemap XML segmenté par type (articles, catégories, produits) pour faciliter le crawl.

Levier 2 : la qualité éditoriale

Google attend des pages utiles, originales et alignées avec une intention de recherche claire. En pratique, quand on compare deux contenus sur le même sujet, la différence d’indexation tient à trois facteurs : profondeur du sujet traité, pertinence des exemples concrets, signaux E-E-A-T (expérience démontrée, expertise sourcée). Un article de 400 mots sans valeur ajoutée a aujourd’hui peu de chances de passer le filtre.

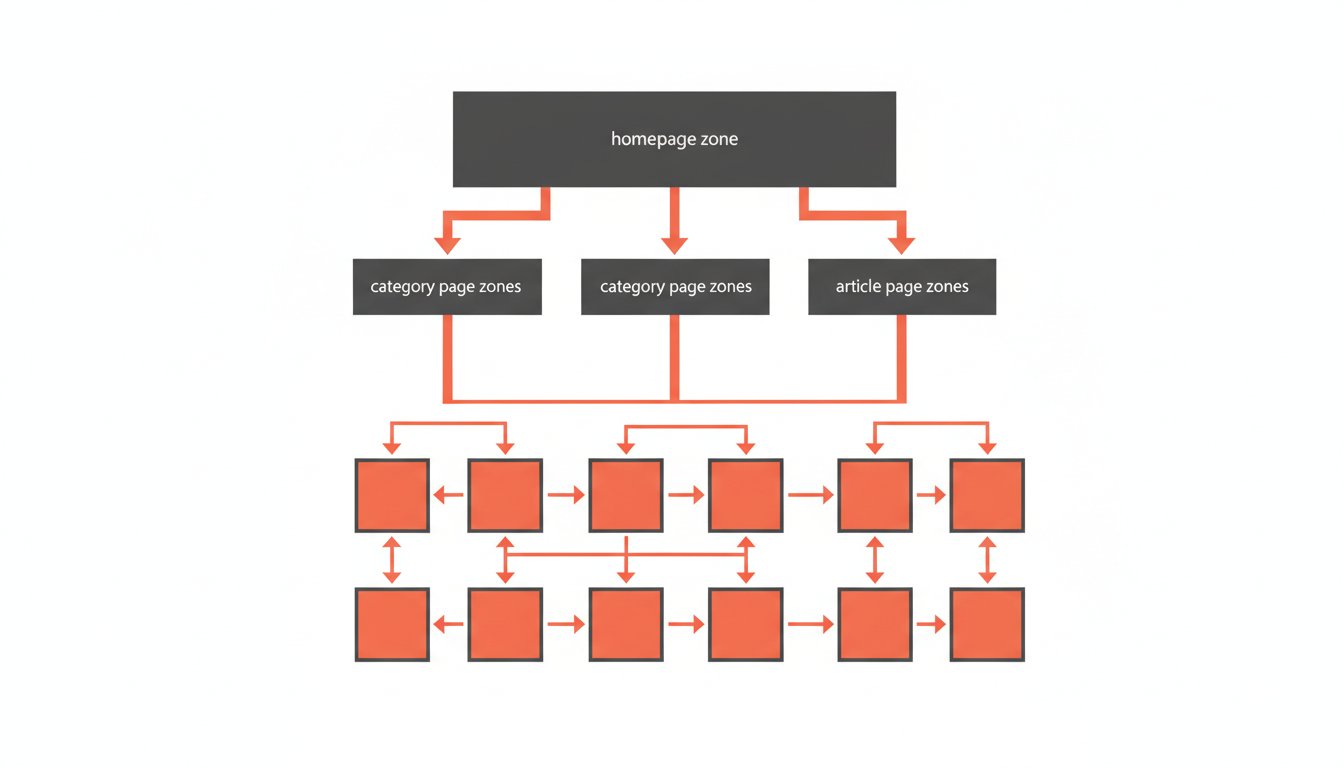

Levier 3 : le maillage interne et les liens externes

Une page sans aucun lien entrant est une page orpheline. Googlebot la découvre difficilement et lui accorde peu de crédit. Le maillage interne doit garantir qu’aucune page stratégique ne soit à plus de 3 clics de la page d’accueil et que chaque page reçoive au minimum 2-3 liens depuis d’autres contenus du site. Côté externe, quelques backlinks de qualité accélèrent fortement l’indexation initiale d’un nouveau contenu.

✅ À vérifier avant de demander une réindexation

- La page est accessible (code 200) et ne contient pas de balise

noindex; - Le contenu a été substantiellement modifié ou enrichi depuis la dernière exploration ;

- Au moins 2 liens internes pointent vers cette page depuis des pages déjà bien indexées ;

- Le sitemap inclut la nouvelle URL et a été mis à jour ;

- Le rapport Search Console ne signale aucune erreur d’exploration sur cette URL.

Demander manuellement l’indexation

La Search Console propose un outil d’inspection d’URL qui permet de soumettre manuellement une page à l’indexation. La documentation officielle Google détaille la procédure pour demander à Google de réexplorer une URL. Cette méthode reste utile pour les pages prioritaires, mais ne contourne pas le filtre qualité : si la page est faible, elle restera hors index même après réindexation forcée.

Pénalité Google : quand l’index se referme

La désindexation brutale d’un site est presque toujours liée à une pénalité Google, qu’elle soit algorithmique ou manuelle. Comprendre les deux types est essentiel pour réagir correctement.

Pénalité manuelle

Un examinateur humain de l’équipe Google a inspecté votre site et identifié une violation des consignes aux webmasters. Le motif apparaît dans la Search Console, section « Actions manuelles ». Causes typiques : netlinking abusif, contenu généré automatiquement sans valeur ajoutée, cloaking, schéma de liens, contenu trompeur.

La sanction peut être partielle (une section du site désindexée) ou totale (site entier exclu). La sortie passe par la correction du problème et une demande de réexamen via la Search Console — délai de traitement de 2 à 6 semaines en moyenne.

Pénalité algorithmique

Aucun message officiel n’apparaît. Le trafic chute brutalement après une mise à jour d’algorithme (Core Update, Helpful Content, Spam Update). La page peut sortir de l’index ou perdre 50 à 90 % de son positionnement. Notre guide pour récupérer d’une pénalité Google détaille la procédure de récupération.

Ce que beaucoup de référenceurs sous-estiment : une pénalité algorithmique se manifeste rarement par un site entièrement désindexé. C’est plutôt un déclassement massif accompagné d’une chute du taux d’indexation des nouvelles pages. Surveiller la courbe d’indexation sur les 90 derniers jours est souvent le meilleur signal précoce.

Alternatives et approches complémentaires

Au-delà des leviers SEO classiques, plusieurs approches permettent d’accélérer ou de contourner certaines difficultés d’indexation. Aucune ne remplace la qualité du contenu, mais elles s’inscrivent en complément.

L’IndexNow Protocol

Soutenu par Bing et Yandex (mais pas officiellement Google à ce jour), IndexNow permet aux sites de notifier instantanément les moteurs d’un nouveau contenu. Solution intéressante pour Bing et Yandex, qui pèsent malgré tout 5 à 10 % du trafic search en France selon les secteurs.

Le ping Search Console automatisé

Pour les sites publiant à fort volume, automatiser la soumission via l’API Search Console (Indexing API pour les pages de type Job Posting ou Live Stream uniquement) permet d’accélérer l’indexation des contenus éligibles. Hors de ces deux cas, l’API n’est pas autorisée par Google pour les contenus standards.

Les services tiers d’indexation

Des services payants (IndexMeNow, Speed Links, etc.) promettent une indexation forcée via des techniques de ping massif et de signaux artificiels. Ils peuvent accélérer l’indexation initiale, mais ne garantissent ni la pérennité dans l’index, ni l’absence d’effet de bord. À utiliser avec parcimonie et jamais comme stratégie principale.

🚨 Erreurs fréquentes qui plombent l’indexation

Erreur 1 — Multiplier les pages thin content

Publier 50 articles de 300 mots sans valeur ajoutée est aujourd’hui la voie royale vers le statut « Explorée, non indexée ». Mieux vaut publier 10 articles de 2 000 mots solides. Dans les données qu’on analyse au quotidien, ce pattern revient régulièrement : les sites qui réduisent volontairement leur volume éditorial au profit de la profondeur voient leur taux d’indexation grimper de 15 à 25 points en quelques mois.

Erreur 2 — Bloquer Googlebot par erreur dans le robots.txt

Un Disallow: / oublié après une mise en production, ou une règle trop large bloquant tout un répertoire stratégique : c’est l’erreur classique du déploiement raté. Toujours vérifier le robots.txt en production avec l’outil de test de la Search Console.

Erreur 3 — Multiplier les canoniques cassées

Une balise canonique qui pointe vers une page différente, vers la page d’accueil ou vers une URL en 404 sème le trouble dans le crawl. Chaque page indexable doit avoir une canonique pointant vers elle-même, sauf cas explicite de consolidation.

Erreur 4 — Ignorer la profondeur d’arborescence

C’est l’erreur qu’on retrouve dans la quasi-totalité des audits de sites en chute d’indexation : 60 à 70 % des pages situées à plus de 4 clics de l’accueil ne sont pas indexées. La solution passe par un aplatissement de la structure et un renforcement des pages-piliers.

Erreur 5 — Mesurer l’indexation au mauvais moment

Tester l’indexation 24 heures après publication n’a aucun sens. Le délai normal d’indexation d’une nouvelle page sur un site de moyenne autorité oscille entre 3 et 21 jours. Mesurer trop tôt mène à des décisions précipitées.

❓ Questions fréquentes sur l’indexation Google

Conclusion

L’indexation Google n’est plus l’étape automatique qu’elle a pu être il y a dix ans. C’est devenu un filtre de qualité actif qui sélectionne les pages dignes d’apparaître dans les résultats. Trois leviers résument l’essentiel : assurer la santé technique du site (crawl fluide, sans erreurs), produire un contenu suffisamment profond pour passer le filtre éditorial, et structurer le maillage interne pour qu’aucune page stratégique ne soit isolée.

Concrètement, votre prochaine étape consiste à ouvrir votre rapport d’indexation Search Console et à isoler le statut le plus représenté hors « Indexée ». C’est le diagnostic le plus rapide et le plus actionnable pour identifier le levier sur lequel travailler en priorité.